Бессерверный прокси для AI.

Таков основной посыл AWS на этой неделе: компания представила новую функцию для AgentCore Runtime в Amazon Bedrock. Теперь речь идёт не просто о запуске AI-агентов, а об их безопасном и грамотном использовании в продакшене. Model Context Protocol (MCP) — это своего рода рукопожатие, которое AI-агенты используют для взаимодействия с инструментами: базами данных, API, чем угодно. Но в реальной эксплуатации эти взаимодействия требуют надзора. Необходима проверка входных данных, протоколирование и маскирование информации — всё это нужно для соблюдения запутанных требований безопасности и регуляторов. Это не абстрактные понятия, а основа ответственного развёртывания AI.

У Amazon Bedrock AgentCore Gateway уже есть некоторые предохранители: семантическое обнаружение инструментов, управляемые учётные данные и контроль политик. Есть даже Lambda-перехватчики для внедрения пользовательской логики. Это подходит для тех, кто строит всё с нуля или готов перенести свою логику в бессерверные функции AWS. Но как быть с легионами предприятий, уже глубоко инвестировавших в собственную логику MCP-фильтрации, возможно, привязанную к локальным системам соответствия? Или теми, кто работает в гибридных средах, где отдельный сервер-прокси предлагает больше гибкости, чем специфичный для системы перехватчик?

Вот тут-то и появляются новые бессерверные MCP-прокси в AgentCore Runtime. Они не замена, а дополняющий паттерн. Их создали для повторного использования, чтобы сократить разрыв между унаследованными инвестициями и растущими требованиями облачных AI-решений.

Программируемый посредник

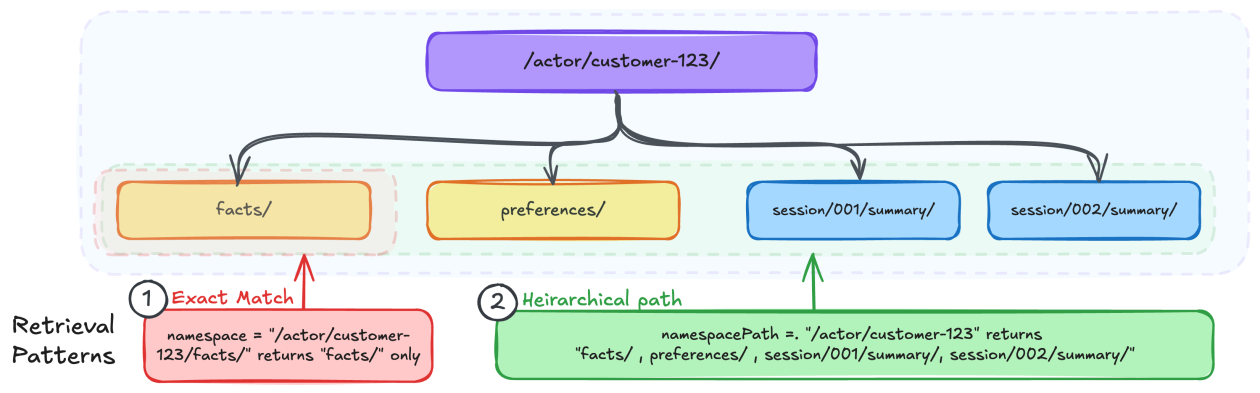

По сути, AgentCore Runtime — это управляемая среда выполнения. Представьте автоматическое масштабирование, встроенную наблюдаемость (CloudWatch, OpenTelemetry) и собственное управление идентификацией. Важно, что он нативно понимает MCP. Это делает его естественным домом для MCP-серверов, а значит, и для этих новых MCP-прокси, которые могут находиться на пути MCP-трафика, применяя ваши пользовательские правила.

Архитектура проста и элегантна: клиент обращается к прокси, прокси выполняет свою работу (валидация, трансформация, фильтрация), а затем перенаправляет запрос на вышестоящий MCP-сервер. Этот сервер может быть где угодно — в самом AgentCore Runtime, на собственных мощностях или в стороннем сервисе. Такая архитектурная гибкость — ключ к успеху. В статье приводится пример использования AgentCore Gateway в качестве вышестоящего сервера для демонстрации, что вполне логично для законченного примера. Но истинная мощь — в расширяемости на другие MCP-совместимые конечные точки. Это как поставить умного регулировщика дорожного движения на границе взаимодействия вашего AI с инструментами.

Прокси работает как бессерверная нагрузка в Runtime, обнаруживает инструменты из вышестоящего MCP-сервера при запуске, повторно предоставляет их с применённой пользовательской логикой и прозрачно перенаправляет запросы.

Этот паттерн позволяет вводить контроль на уровне протокола, не затрагивая вышестоящий сервер или само клиентское приложение. Это форма латерального контроля, позволяющая вмешаться без полной перестройки системы.

Связывая прошлое и будущее: от локальных серверов к облаку

Ключевое противоречие, которое статья умело обыгрывает, — это инерция существующей инфраструктуры против стремления к современным, масштабируемым облачным сервисам. Многие организации потратили годы — и значительные средства — на создание собственных систем управления и соответствия. Они не собираются полностью отказываться от них ради новой AI-платформы. Этот бессерверный MCP-прокси предлагает путь к интеграции этих существующих возможностей с AgentCore Runtime Bedrock. Это прагматичный подход к внедрению AI, признающий, что корпоративный IT-ландшафт редко бывает чистым листом.

Это также имеет значение для стратегий мультиоблачных или гибридных облачных решений. Если ваша MCP-логика находится на отдельном сервере или группе серверов, теперь их будет легче интегрировать в AI-агентский рабочий процесс, ориентированный на AWS. Прокси выступает как своего рода Розеттский камень, переводящий между различными средами и протоколами. Дело не столько в миграции, сколько во взаимодействии.

Почему это важно для разработчиков?

Для разработчиков, создающих AI-агентов и интегрирующих их с различными инструментами, этот новый паттерн прокси вводит мощный уровень абстракции. Это означает, что вы можете сосредоточиться на основной логике агента и бизнес-функциональности инструментов, переложив сложные, специфичные для среды задачи управления и безопасности на этот выделенный слой прокси. Если ваша организация имеет устоявшиеся методы обработки конфиденциальных данных или проверки вызовов API, их теперь можно подключить к экосистеме Bedrock без необходимости полного переписывания.

Подумайте о конфиденциальности данных. Регуляторы, такие как GDPR или CCPA, предписывают строгие меры контроля над персональными данными. Прокси можно настроить на автоматическое маскирование или анонимизацию персональных данных (PII) до того, как они попадут в серверную систему или внешний API. Или возьмите аудит. Вместо того чтобы пытаться добавить логирование в каждую интеграцию с инструментом, прокси может генерировать стандартизированные журналы аудита в формате, который ваша команда безопасности сможет легко обрабатывать и анализировать. Это значительно снижает нагрузку на отдельные команды разработчиков и централизует контроль.

Архитектурный сдвиг здесь тонок, но значителен. Вместо того чтобы встраивать безопасность и управление непосредственно в логику взаимодействия каждого агента с инструментами, или полагаться исключительно на API-шлюзы и Lambda-функции, у вас теперь есть выделенный MCP-совместимый посредник. Эта специализация позволяет более тонко контролировать и лучше разделять обязанности. Это шаг к более модульной и управляемой архитектуре AI-агентов, что именно и необходимо по мере того, как эти агенты становятся сложнее и интегрируются в критически важные бизнес-процессы.

Что означает “MCP” в MCP Proxy?

MCP расшифровывается как Model Context Protocol (Протокол контекста модели). По сути, это стандартизированный способ взаимодействия AI-моделей (или агентов) с внешними инструментами или службами. Представьте его как универсальный язык, который позволяет AI-агенту запрашивать информацию или инициировать действия у инструмента, а инструменту — отправлять обратно результаты. Часть “контекст” относится к информации, необходимой модели для понимания и выполнения запроса, а “протокол” определяет, как эта информация структурируется и обменивается.

Пользовательский MCP-прокси, как описано в статье, — это программное обеспечение, которое находится между участниками этого обмена. Оно перехватывает MCP-сообщения, применяет свои собственные правила (например, проверки безопасности или преобразования данных) и затем перенаправляет изменённое сообщение фактическому инструменту. Это позволяет организациям добавлять свои собственные уровни контроля и настройки к тому, как AI-агенты взаимодействуют с их системами, без необходимости модифицировать сам AI-агент или базовые инструменты.

Внедрение бессерверного MCP-прокси в Amazon Bedrock AgentCore Runtime означает, что эта пользовательская логика может быть развёрнута и управляться в высокомасштабируемой и экономически эффективной форме, работая на управляемой инфраструктуре AWS. Это упрощает развёртывание и снижает операционные расходы для организаций, желающих реализовать детальный контроль над использованием инструментов своими AI-агентами.

Мой взгляд: кивок в сторону прагматизма

Что меня больше всего поражает, так это признание того, что внедрение корпоративного AI — это не сценарий “вырви и замени”. У компаний есть существующие системы, требования соответствия и устоявшиеся инженерные практики. Этот бессерверный MCP-прокси — умный ход со стороны AWS, потому что он уважает эту реальность. Он предоставляет способ постепенно интегрировать передовые AI-возможности, не требуя полного архитектурного пересмотра. Это прагматичный шаг, который снижает порог входа для организаций, которые в противном случае могли бы колебаться перед переходом на облачные AI-агентские решения из-за сложности ретрофита безопасности и управления. Это не просто новая технология; это способ обеспечить внедрение, встречая клиентов там, где они находятся.