AIのためのサーバーレスプロキシ。

それが今週、AWSがAmazon BedrockのAgentCore Runtime向けに発表した新機能の中核だ。もはやAIエージェントを実行するだけでなく、本番環境でそれを「安全に」「賢く」実行することが重要になっている。モデルコンテキストプロトコル(MCP)は、AIエージェントがデータベースやAPIなど、ありとあらゆるツールと通信するための「握手」のようなものだ。しかし、現実はもっと複雑で、これらのやり取りには「番人」が必要になる。入力のサニタイズ、監査ログ、データマスキングなど、組織が抱える複雑怪奇なセキュリティや規制の要求を満たすためだ。これらは抽象的な概念ではなく、責任あるAIデプロイメントの「礎(いしずえ)」となるものだ。

現在、Amazon Bedrock AgentCore Gatewayは、セマンティックなツール発見、認証情報の管理、ポリシー適用といった、いくつかのガードレールを提供している。カスタムロジックの注入のためにLambdaインターセプターもサポートされている。これは、ゼロから構築する開発者や、AWSのサーバーレス関数にロジックをリファクタリングすることに抵抗がない開発者向けだ。しかし、カスタムMCPフィルタリングロジックにすでに深く投資している、あるいはオンプレミスのコンプライアンスシステムに依存している多くの企業はどうだろうか?あるいは、スタンドアロンのプロキシサーバーがシステム固有のインターセプターよりも汎用性が高いハイブリッド環境で運用している企業は?

そこで、AgentCore Runtimeにおける新しいサーバーレスMCPプロキシが登場する。これは置き換えではなく、補完的なパターンだ。既存の投資と、クラウドネイティブAIの進化する要求との間のギャップを埋めることを目指し、再利用のために設計されている。

プログラマブルな仲介者

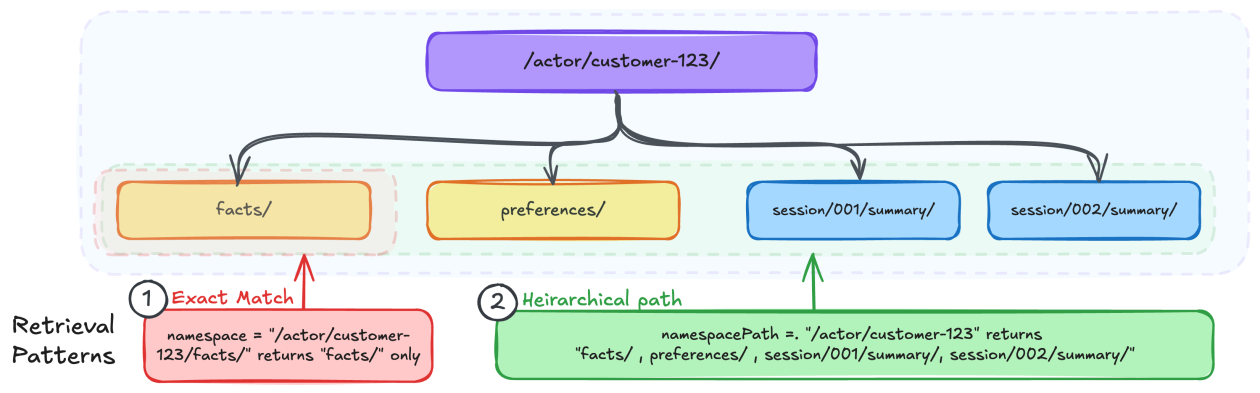

AgentCore Runtimeは、本質的にはマネージドなコンピューティング環境だ。自動スケーリング、組み込みのオブザーバビリティ(CloudWatch、OpenTelemetry)、そして独自のID管理を想像してみてほしい。重要なのは、MCPをネイティブに理解することだ。これにより、MCPサーバーにとって自然な「ホーム」となり、ひいてはMCPトラフィックの経路に配置してカスタム制御を適用できるこれらの新しいMCPプロキシにとっても、同様のことが言える。

説明されているアーキテクチャは、そのシンプルさにおいてエレガントだ。クライアントはプロキシと通信し、プロキシは自身の処理(検証、変換、フィルタリング)を行い、その後、リクエストをアップストリームのMCPサーバーに転送する。アップストリームサーバーはどこにあってもよい――AgentCore Runtime自体、セルフホスト、あるいはサードパーティサービスでも。このアーキテクチャの柔軟性が鍵となる。デモ walkthrough では AgentCore Gateway をアップストリームサーバーとして使用しているのが紹介されており、スタンドアロンデモとしては理にかなっている。しかし、真の力は、他のMCP互換エンドポイントへの拡張性にある。AIのツール連携の「エッジ」にインテリジェントな交通整理員を配置するようなものだ。

プロキシはRuntime上でサーバーレスワークロードとして実行され、起動時にアップストリームMCPサーバーからツールを発見し、カスタムロジックを適用して再公開し、リクエストを透過的に転送します。

このパターンにより、アップストリームサーバーやクライアントアプリケーション自体に手を加えることなく、プロトコルレイヤーで制御を導入できる。これは、システム全体をオーバーホールすることなく介入を可能にする、横断的な制御の一形態だ。

ギャップを埋める:オンプレミスからクラウドへ

この記事が巧みに扱っている根本的な緊張関係は、既存インフラストラクチャの慣性対、最新のスケーラブルなクラウドサービスへの推進力だ。多くの組織は、内部ガバナンスフレームワークやコンプライアンスツールを構築するために、長年――そして多大な資本を――費やしてきた。新しいAIプラットフォームを採用するためだけに、それらをすべて置き換えることはないだろう。このサーバーレスMCPプロキシは、既存の機能をBedrockのAgentCore Runtimeと「統合」するための道を提供する。これは、エンタープライズIT環境がほとんど「白紙」ではないという現実を認識した、AI導入のための実用的なアプローチだ。

これは、マルチクラウドまたはハイブリッドクラウド戦略にも影響を与える。MCPロジックがスタンドアロンサーバーまたはサーバー群に格納されている場合、これらはAWS中心のAIエージェントワークフローにより容易に統合できるようになる。プロキシは、異なる環境やプロトコル間の「ロゼッタストーン」として機能する。移行というよりは、相互運用性に関するものだ。

開発者にとってなぜ重要なのか?

AIエージェントを構築し、ツールと統合する開発者にとって、この新しいプロキシパターンは強力な抽象化レイヤーをもたらす。これにより、開発者はコアエージェントロジックとツールのビジネス機能に集中できる一方、複雑で環境固有のガバナンスやセキュリティの懸念を、この専用プロキシレイヤーにオフロードできる。組織が機密データを処理したり、特定のAPI呼び出し検証を強制したりするための確立された方法を持っている場合、それらは完全な書き換えを必要とせずにBedrockエコシステムに「プラグイン」できるようになる。

データプライバシーを考えてみよう。GDPRやCCPAのような規制は、個人データに対する厳格な管理を義務付けている。プロキシは、バックエンドシステムや外部APIに到達する「前」に、個人識別情報(PII)を自動的にマスキングまたは匿名化するように設定できる。あるいは、監査ログについて考えてみよう。すべてのツール統合にロギングを後付けしようとするのではなく、プロキシはセキュリティチームが容易に消費・分析できる形式で標準化された監査ログを生成できる。これにより、個々の開発チームの負担が大幅に軽減され、制御が一元化される。

ここでのアーキテクチャシフトは微妙だが、重大だ。各エージェントのツール連携ロジックに直接セキュリティやガバナンスを構築したり、APIゲートウェイやLambda関数だけに頼ったりするのではなく、MCPを認識した専用の仲介者を持つことになる。この特化により、より洗練された制御と、懸念事項のより良い分離が可能になる。これは、エージェントがますます複雑になり、重要なビジネスプロセスに組み込まれるにつれて、まさに必要とされる、よりモジュラーで管理可能なAIエージェントアーキテクチャへの一歩だ。

MCPプロキシの「MCP」とは?

MCPはModel Context Protocolの略だ。これは基本的に、AIモデル(またはエージェント)が外部ツールやサービスと対話するための標準的な方法だ。AIエージェントがツールに情報要求をしたり、アクションをトリガーしたり、ツールが結果を返したりすることを可能にする、普遍的な言語だと考えてほしい。「コンテキスト」の部分は、モデルがリクエストを理解し実行するために必要な情報、「プロトコル」は、その情報がどのように構造化され、交換されるかを定義している。

記事で説明されているカスタムMCPプロキシは、この通信の中間に位置するソフトウェアだ。MCPメッセージをインターセプトし、独自のカスタムルール(セキュリティチェックやデータ変換など)を適用してから、変更されたメッセージを実際のツールに転送する。これにより、組織はAIエージェント自体や基盤となるツールを変更することなく、AIエージェントがシステムと対話する方法に独自の制御とカスタマイズのレイヤーを追加できる。

Amazon Bedrock AgentCore RuntimeにおけるサーバーレスMCPプロキシの導入は、このカスタムロジックが、AWSのマネージドインフラストラクチャ上で実行される、高度にスケーラブルでコスト効率の高い方法でデプロイ・管理できることを意味する。これにより、AIエージェントのツールの使用に対してきめ細かな制御を実装したい組織にとって、デプロイメントと運用オーバーヘッドが簡素化される。

私の見解:実用主義への敬意

最も印象的なのは、エンタープライズAI導入が「すべてを置き換える」シナリオではないという認識だ。企業には既存のシステム、コンプライアンス要件、確立されたエンジニアリングプラクティスがある。このサーバーレスMCPプロキシは、AWSにとって賢明な一手であり、その現実を尊重している。これは、大規模なアーキテクチャの変更を要求することなく、高度なAI機能を段階的に統合する方法を提供する。これは、セキュリティとガバナンスの後付けの複雑さのために、クラウドネイティブAIエージェントのデプロイメントにコミットすることをためらっていたかもしれない組織にとって、参入障壁を下げる実用的な一歩だ。これは単なる新技術ではなく、顧客が現在いる場所で彼らに会うことで、導入を可能にすることなのだ。