Дообучение мультимодальных эмбеддингов с Sentence Transformers: реальный профит или очередной бенчмарк?

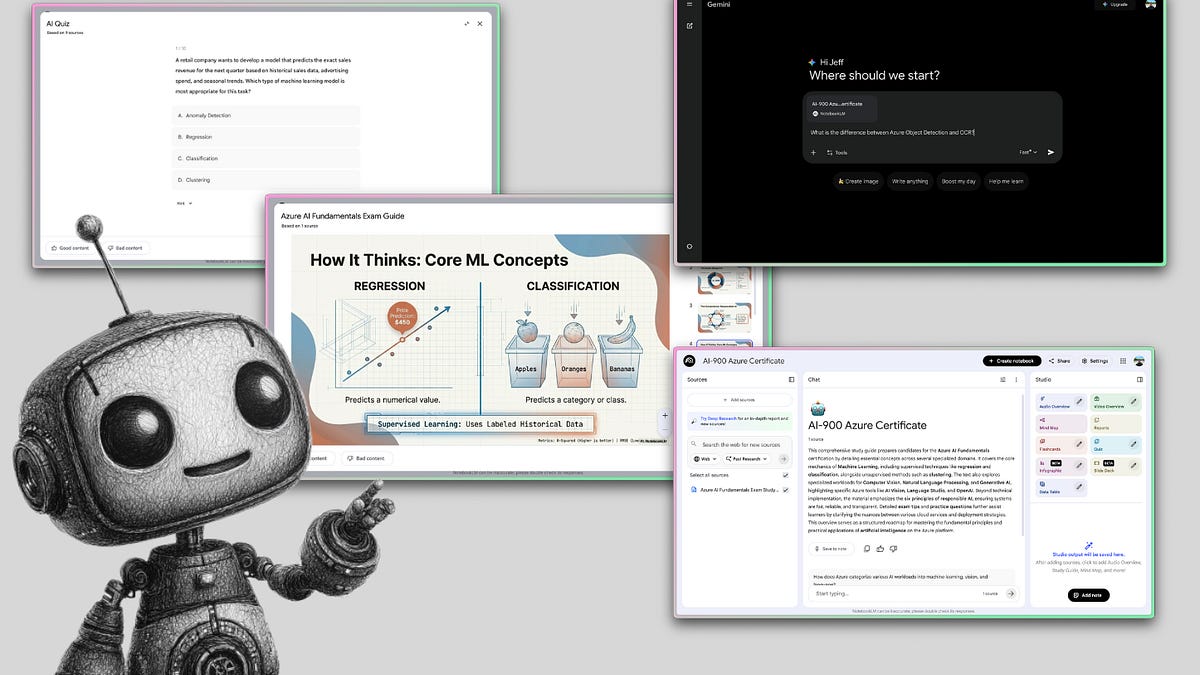

За 20 лет я видел тысячу «прорывных» твиков моделей, но это дообучение мультимодального эмбеддера от Qwen действительно работает: 0.947 NDCG на VDR, обгоняя соперников вчетверо больше. Но кто на этом заработает?

⚡ Key Takeaways

- Дообучение Qwen3-VL-Embedding-2B на данных VDR повышает NDCG@10 до 0.947, опережая более крупных конкурентов. 𝕏

- Пайплайн Sentence Transformers удобен для разработчиков в области мультимодальных эмбеддингов и реранкеров. 𝕏

- Реальные результаты требуют данных предметной области; универсальные модели не справляются со специализированными задачами, такими как макеты документов. 𝕏

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Hugging Face Blog