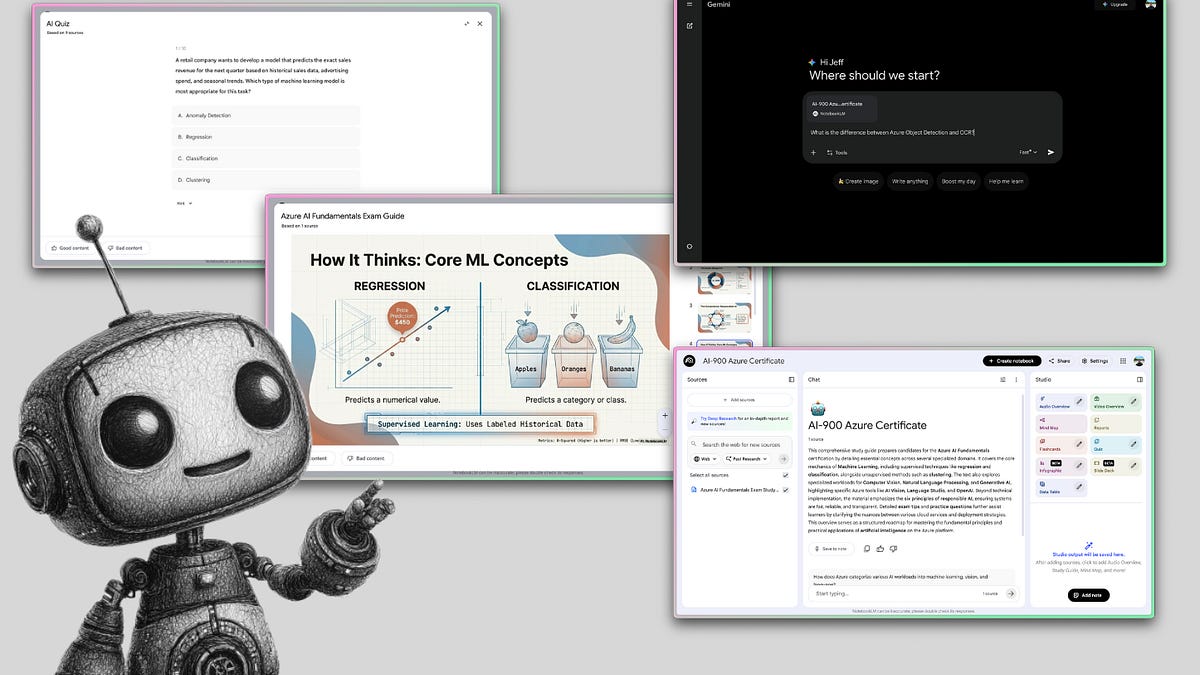

Sentence Transformers로 멀티모달 임베딩 파인튜닝: 실질적인 성과인가, 아니면 또 다른 벤치마크 승리인가?

지난 20년간 수많은 '혁신적인' 모델 개선을 봐왔지만, 이 Qwen의 멀티모달 임베더 파인튜닝은 실제로 결과물을 보여줍니다. VDR에서 0.947 NDCG를 달성하며, 4배나 큰 경쟁 모델들을 압도하죠. 하지만 누가 이걸로 돈을 벌고 있을까요?

⚡ Key Takeaways

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Hugging Face Blog