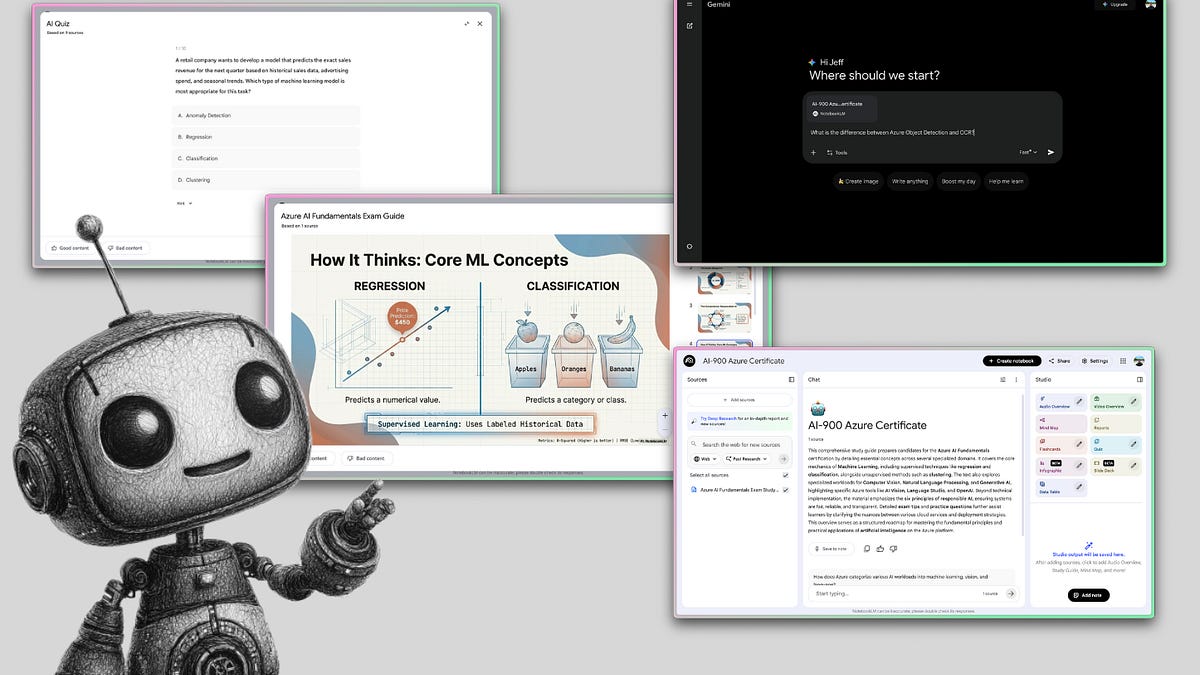

Sentence Transformersでマルチモーダル埋め込みをファインチューニング:真の成果か、それとも単なるベンチマーク勝利か?

20年間で1000もの「画期的」なモデル改良を見てきたが、このQwenのマルチモーダル埋め込みモデルのファインチューニングは、まさに本物だ。VDRでNDCG 0.947を叩き出し、その4倍のサイズを持つ競合モデルを圧倒している。しかし、一体誰がこの利益を得るのだろうか?

⚡ Key Takeaways

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Hugging Face Blog