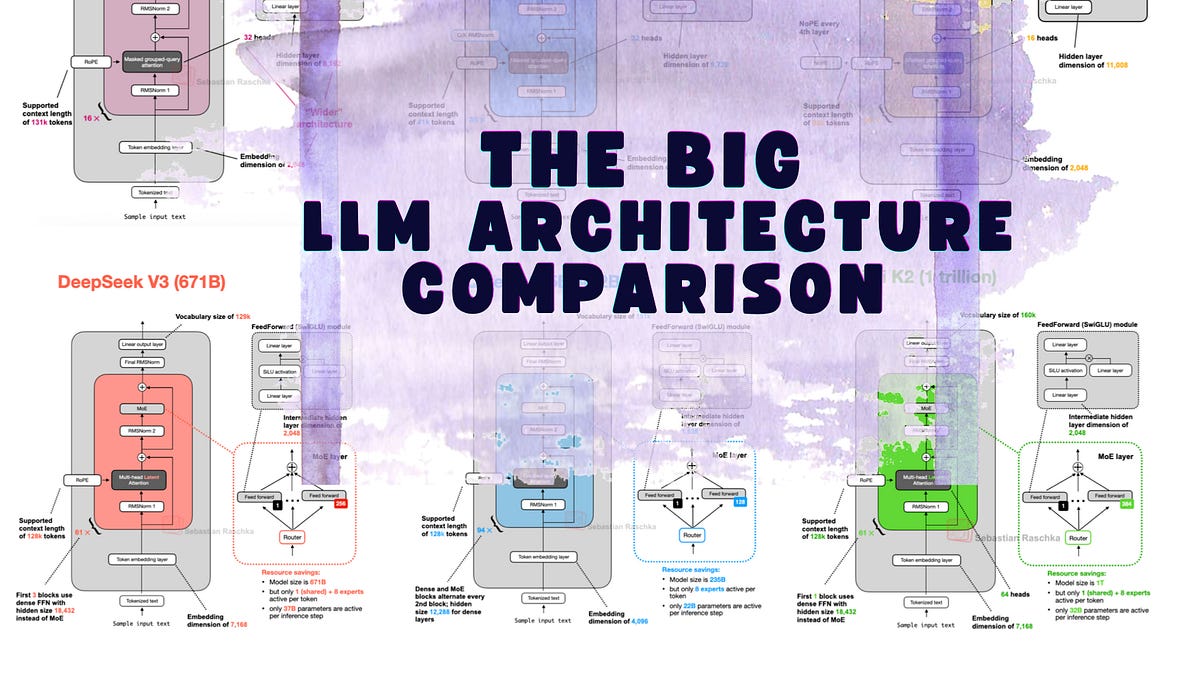

DeepSeek V3'ün Gizli Dikkat Mekanizması KV Önbellek Şişkinliğini Ezdi

DeepSeek V3 LLM bellek krizini azalttı. Çok Başlı Gizli Dikkat (MLA) mekanizması KV önbelleklerini küçültürken performansı bozmuyor — işte veriler.

⚡ Key Takeaways

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Ahead of AI