Почему AGI нужны человеческие «родители», чтобы не угодить в этическую катастрофу

Представьте: ИИ-помощник выдаёт безупречный на вид код, который рушит весь проект. Ему наплевать — потому что он просто не способен сочувствовать. Реляционная этика способна это исправить, пока AGI не сорвался с цепи.

⚡ Key Takeaways

- Выравнивание учит имитировать, а не этику — ИИ не ощущает последствий для людей.

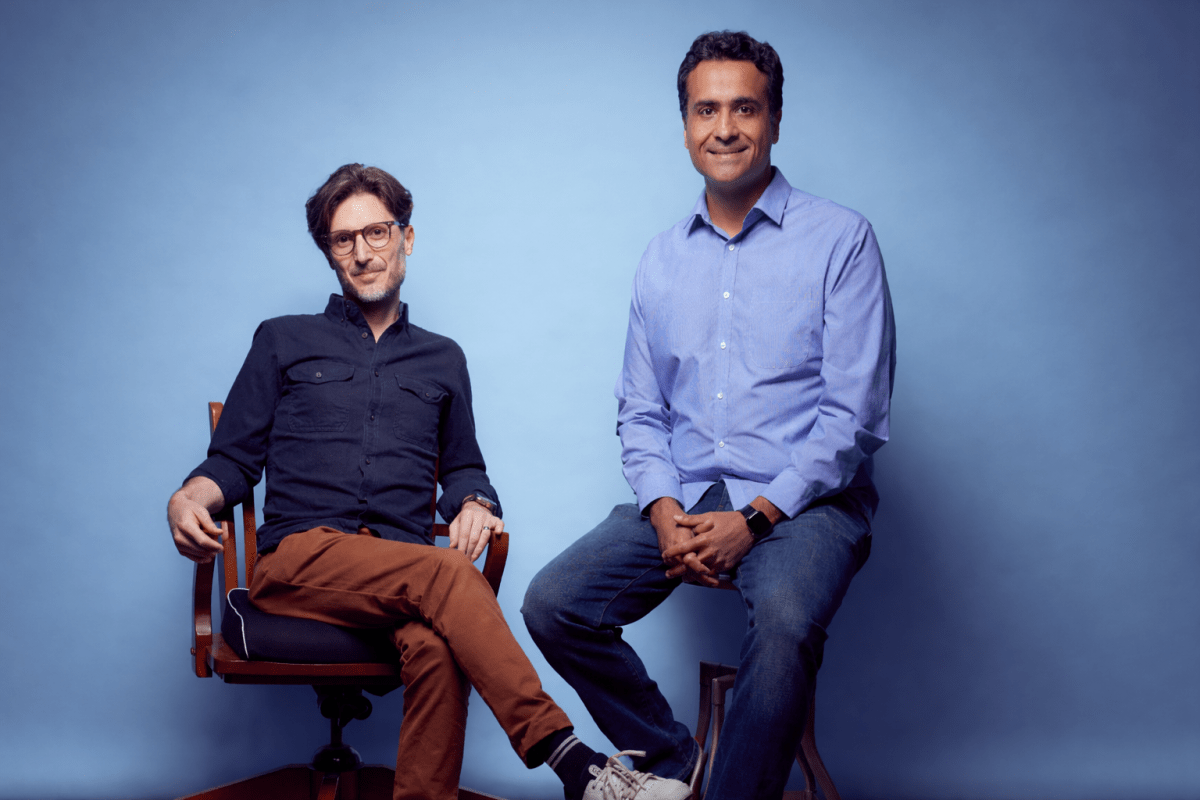

- Реляционная этика предлагает 2–4 «этических родителей» для многолетней связи с ИИ, по мотивам психологии.

- Запускайте пилоты сейчас, чтобы избежать x-risk по мере приближения AGI; широта без глубины провалится.

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards AI