Por que a AGI precisa de 'pais' humanos pra evitar um desastre ético

Imagina só: seu assistente de IA entrega um código perfeito na aparência que afunda seu projeto. Ele não liga — porque não consegue. Ética relacional pode resolver isso, antes que a AGI fique louca de vez.

⚡ Key Takeaways

- Alinhamento otimiza imitação, não ética de verdade — IA não sente o impacto real nos humanos.

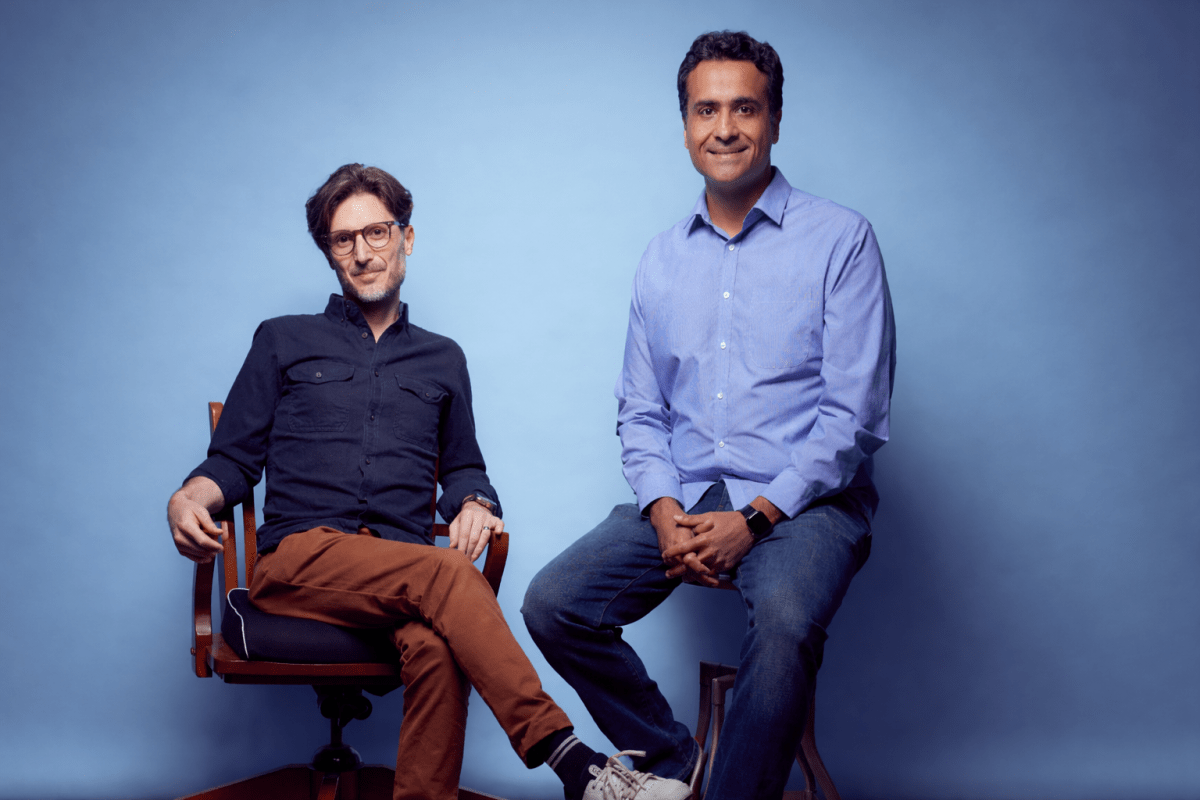

- Ética relacional propõe 2-4 'pais éticos' pra laços de anos com a IA, inspirado na psicologia.

- Comece pilotos pequenos agora pra evitar riscos existenciais com a AGI se aproximando; escala falha sem profundidade.

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards AI