Atenção Latente do DeepSeek V3 Detona o Inchaço do Cache KV

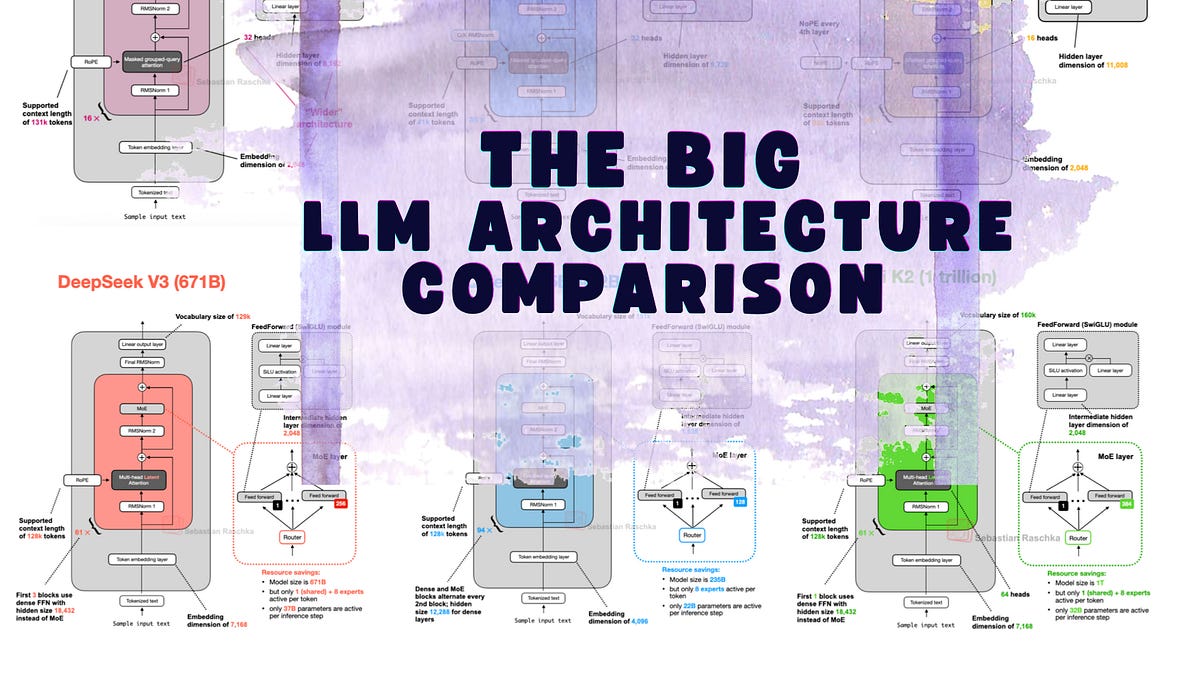

DeepSeek V3 acabou de resolver a crise de memória dos LLM. Sua Atenção Latente Multi-Cabeça encolhe o cache KV sem ferrar o desempenho — olha os dados aqui.

⚡ Key Takeaways

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Ahead of AI