DeepSeek V3 MLA, KV 캐시 비대화 완전 박살

DeepSeek V3가 LLM 메모리 위기 단숨에 압축했다. MLA가 KV 캐시 줄이면서 성능 안 죽임 — 데이터로 확인.

⚡ Key Takeaways

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

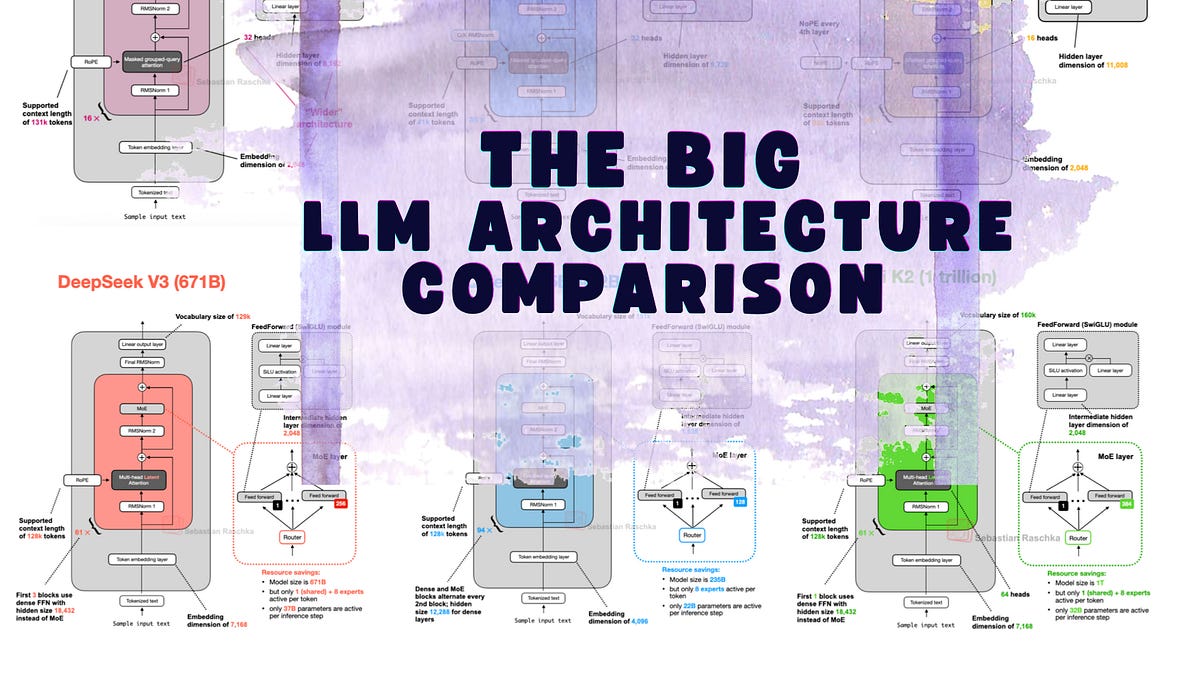

Originally reported by Ahead of AI