DeepSeek V3のMLA、KVキャッシュ肥大をぶっ潰す

DeepSeek V3がLLMのメモリ危機を圧縮した。Multi-Head Latent AttentionがKVキャッシュを性能犠牲なしに縮小——データはこれだ。

⚡ Key Takeaways

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

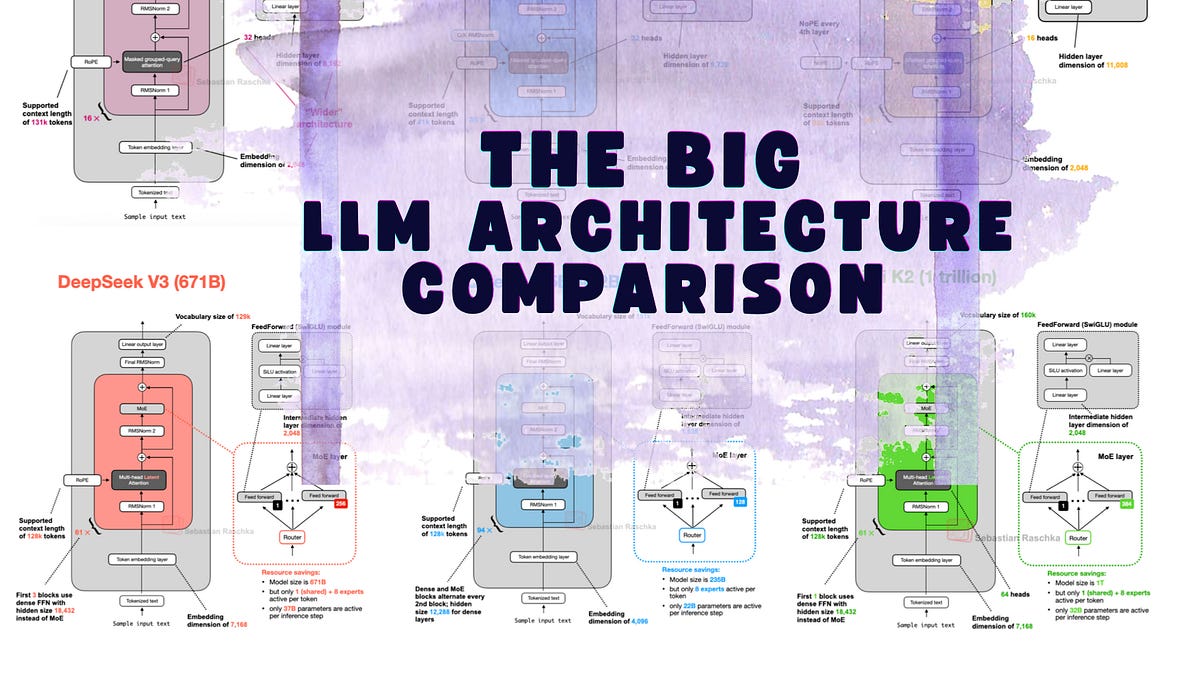

Originally reported by Ahead of AI