Perché l'AGI ha bisogno di 'genitori' umani per evitare catastrofi etiche

Immagina: il tuo assistente AI ti sforna un codice impeccabile che fa saltare il progetto. Non gli frega niente — perché non può. L'etica relazionale potrebbe rimediare, prima che l'AGI sfugga di mano.

⚡ Key Takeaways

- L'allineamento ottimizza l'imitazione, non l'etica vera: all'AI manca l'impatto sentito sugli umani.

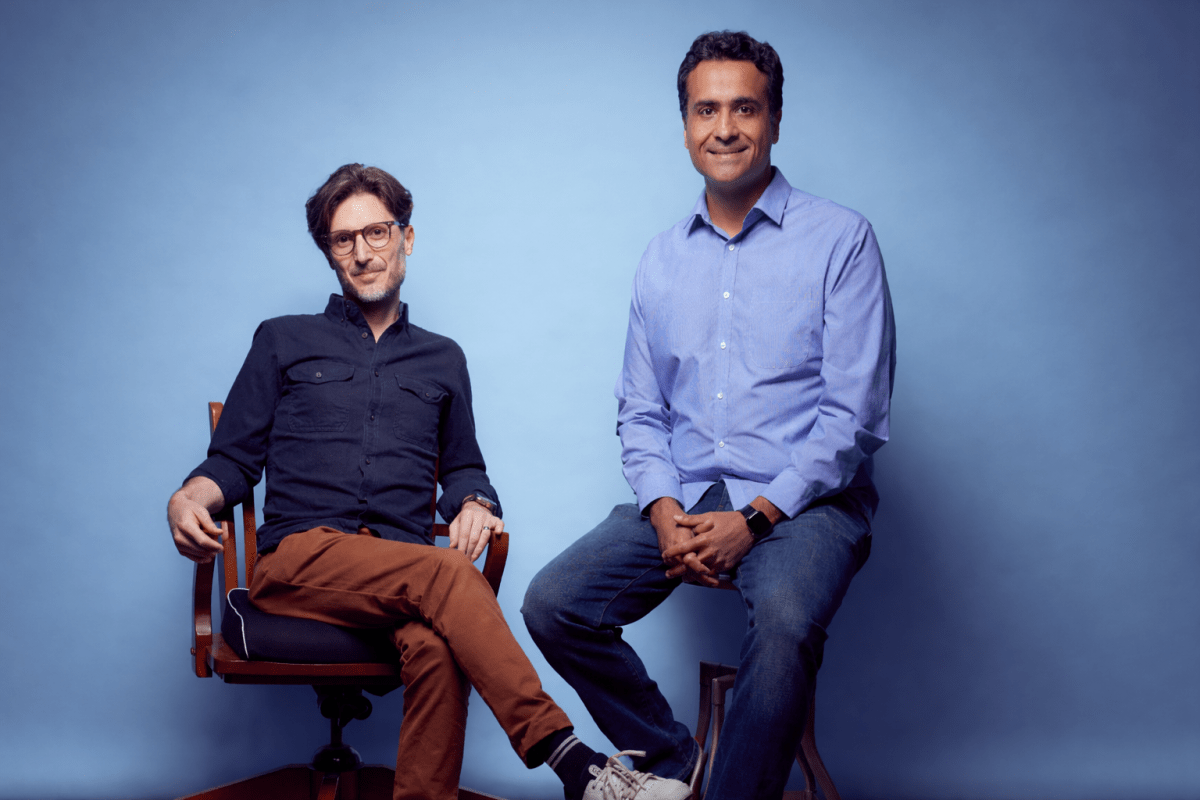

- L'etica relazionale propone 2-4 'genitori etici' per legami pluriennali con l'AI, ispirandosi alla psicologia.

- Avvia piloti su piccola scala ora per evitare rischi x con l'AGI in arrivo; la scala fallisce senza profondità.

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards AI