DeepSeek V3: l'Attenzione Latente Schiaccia il Gonfiore del KV Cache

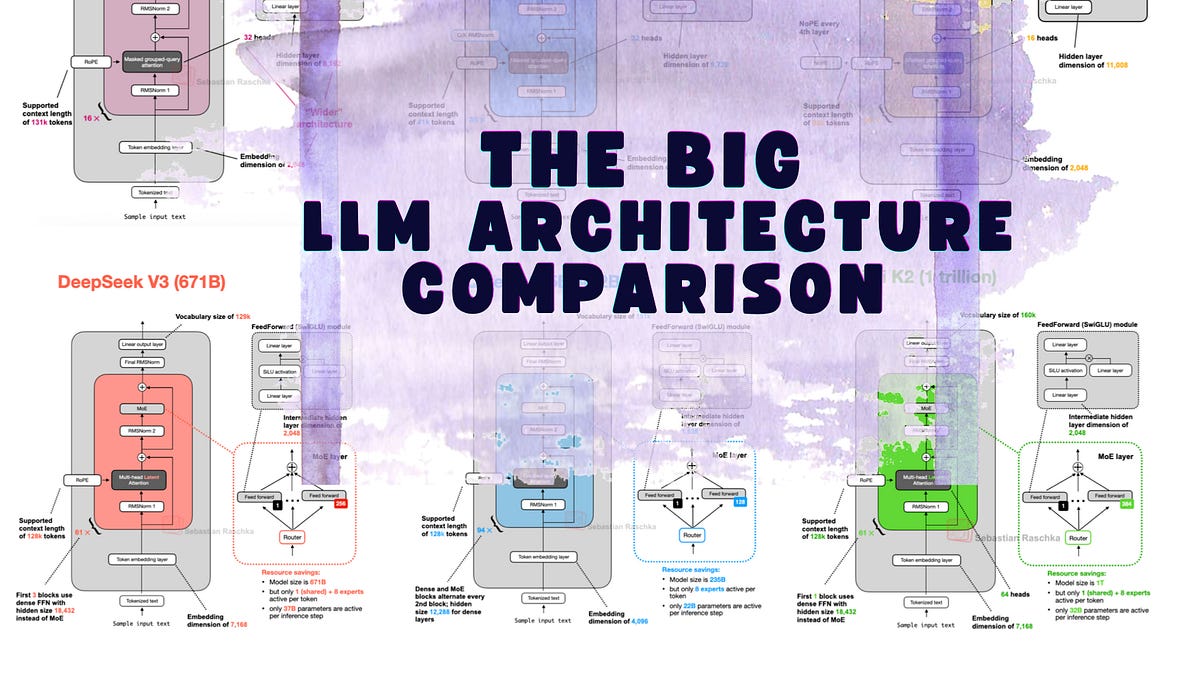

DeepSeek V3 ha appena risolto la crisi di memoria degli LLM. La sua Multi-Head Latent Attention riduce i KV cache senza intaccare le performance: ecco i dati.

⚡ Key Takeaways

- L'MLA di DeepSeek V3 taglia il 40% sul KV cache rispetto al GQA, rivoluzionando l'economia dell'inferenza. 𝕏

- La sparsità MoE è ormai standard, ma l'addestramento del router resta il punto debole. 𝕏

- Il core transformer resiste; i ritocchi incrementali come la compressione vincono i mercati, non le rivoluzioni. 𝕏

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Ahead of AI