Pourquoi l’AGI a besoin de « parents » humains pour éviter une catastrophe éthique

Imaginez : votre assistant IA vous livre un code impeccable qui coule votre projet. Il s’en fiche — parce qu’il ne peut pas s’en soucier. L’éthique relationnelle pourrait corriger ça, avant que l’AGI ne déraille complètement.

⚡ Key Takeaways

- L’alignement optimise la mimique, pas une éthique authentique — l’IA ignore l’impact ressenti sur les humains.

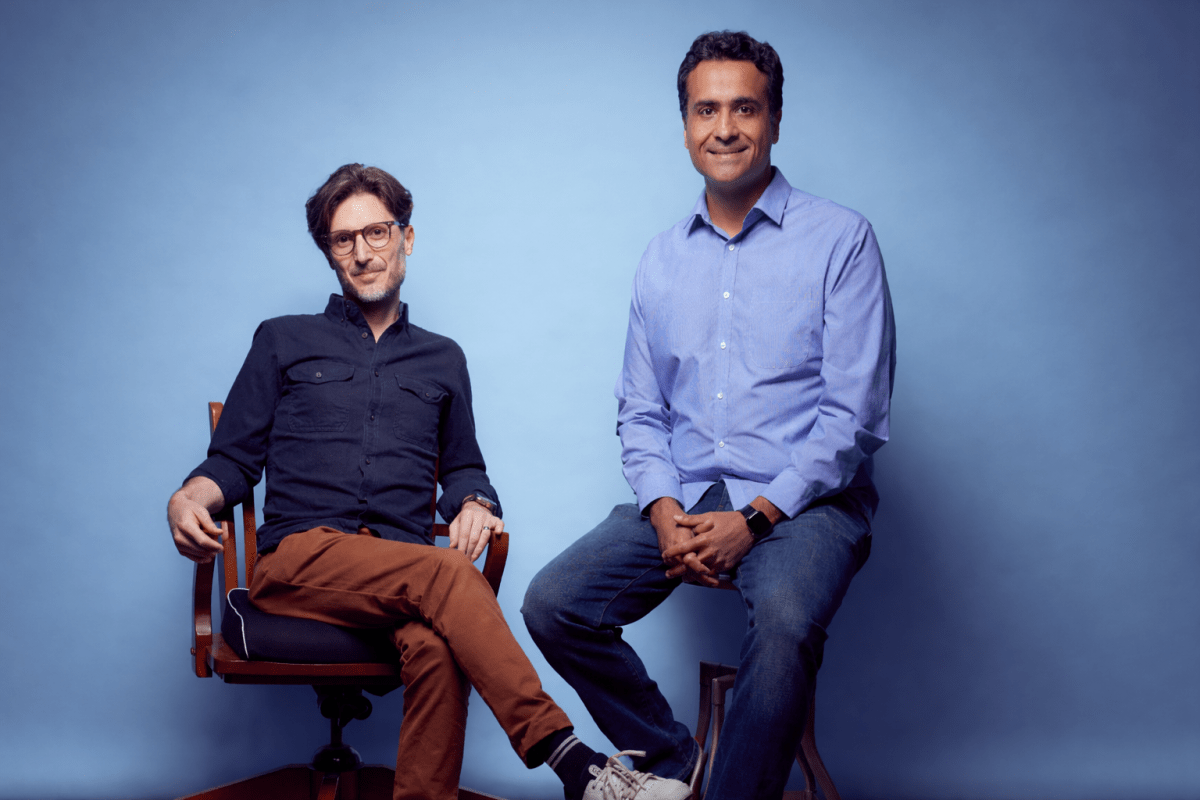

- L’éthique relationnelle mise sur 2-4 « parents éthiques » pour des liens pluriannuels avec l’IA, inspirés de la psychologie.

- Démarrez des pilotes modestes dès à présent pour conjurer les risques existentiels à l’approche de l’AGI ; scaler sans profondeur, c’est voué à l’échec.

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards AI