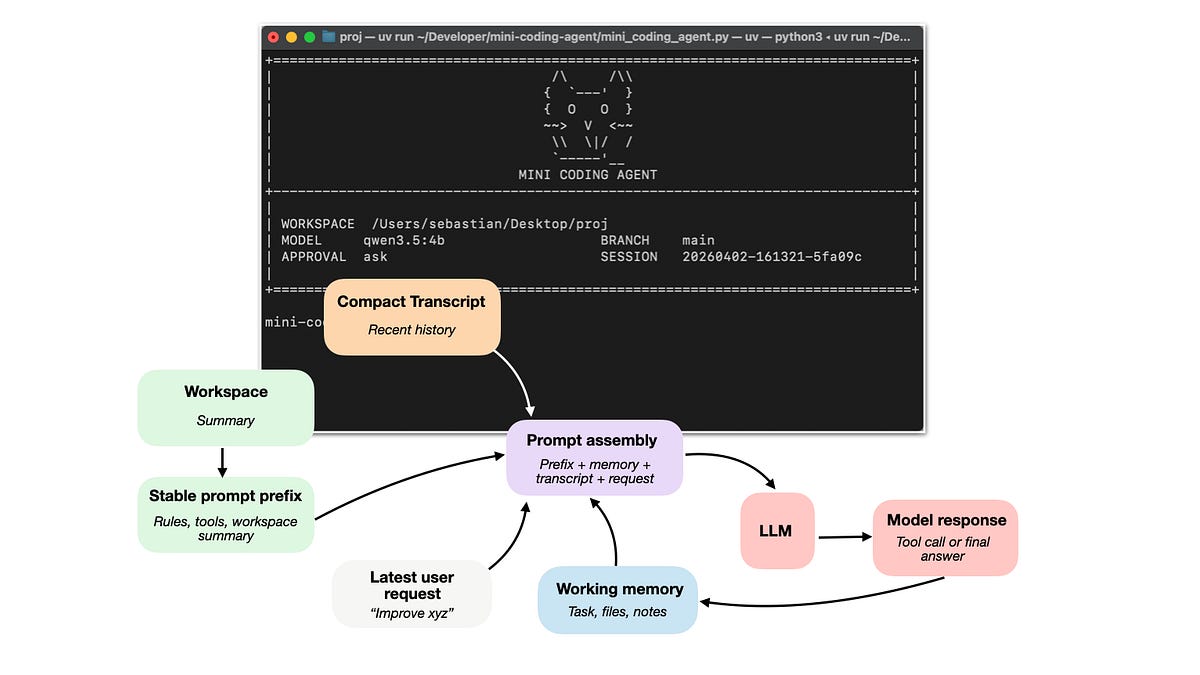

Les pipelines de déploiement IA : des modèles parfaits à l'enfer de la production

Votre modèle IA cartonne en labo. Déployez-le en prod — et voilà la latence qui explose, les coûts qui s'envolent. La vérité crue sur ces pipelines qui mènent de l'entraînement au triomphe (ou au désastre).

⚡ Key Takeaways

- Les pipelines de déploiement gèrent 90 % des défis du cycle de vie ML, de la conteneurisation au scaling. 𝕏

- L'inférence optimise les prédictions low-latency avec des outils comme Triton et vLLM. 𝕏

- L'inférence serverless promet la simplicité mais galère avec les cold starts GPU — l'hybride domine pour l'instant. 𝕏

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards AI