¿Por qué la AGI necesita 'padres' humanos para evitar un desastre ético?

Imagina esto: tu asistente IA te suelta código impecable que hunde tu proyecto. No le importa, porque no puede importarle. La ética relacional podría solucionarlo antes de que la AGI se salga de control.

⚡ Key Takeaways

- La alineación optimiza la imitación, no ética de verdad: la IA no siente su impacto en humanos.

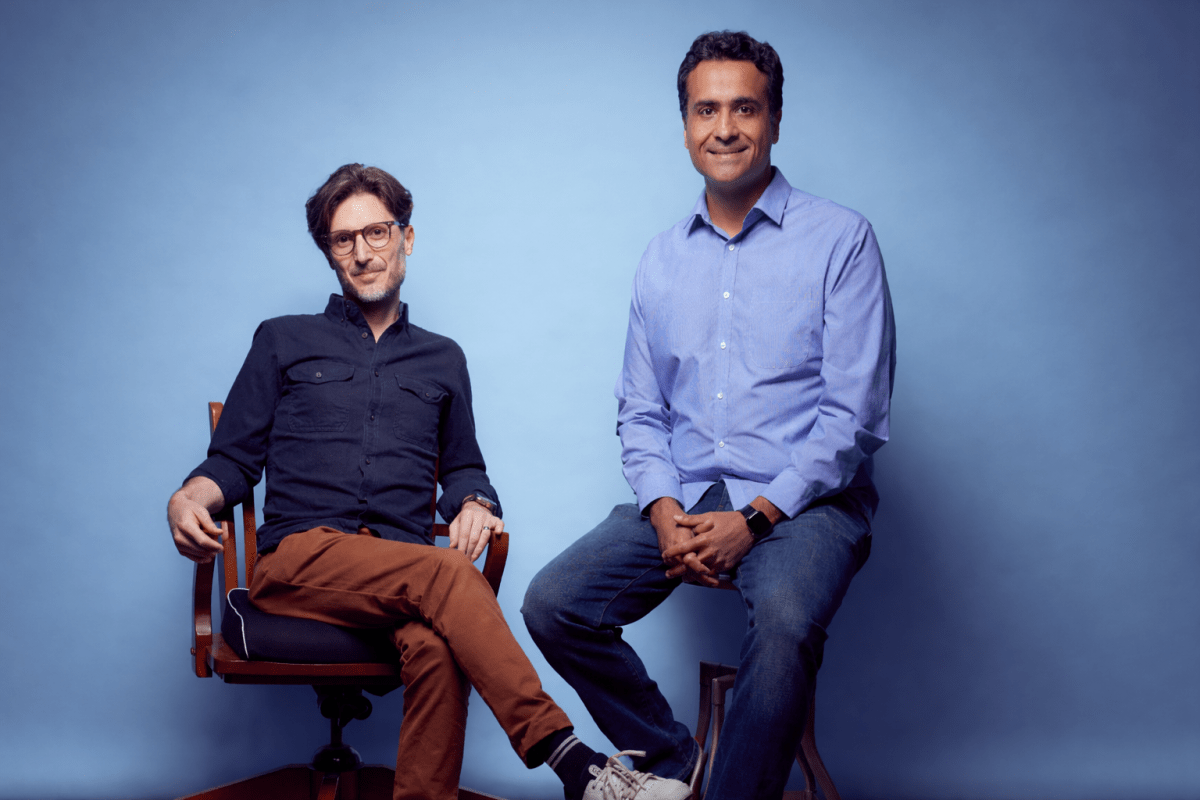

- La ética relacional propone 2-4 'padres éticos' para lazos multianuales con IA, inspirado en psicología.

- Arranca pilotos pequeños ya para evitar riesgos existenciales ante AGI inminente; escalar sin profundidad falla.

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards AI