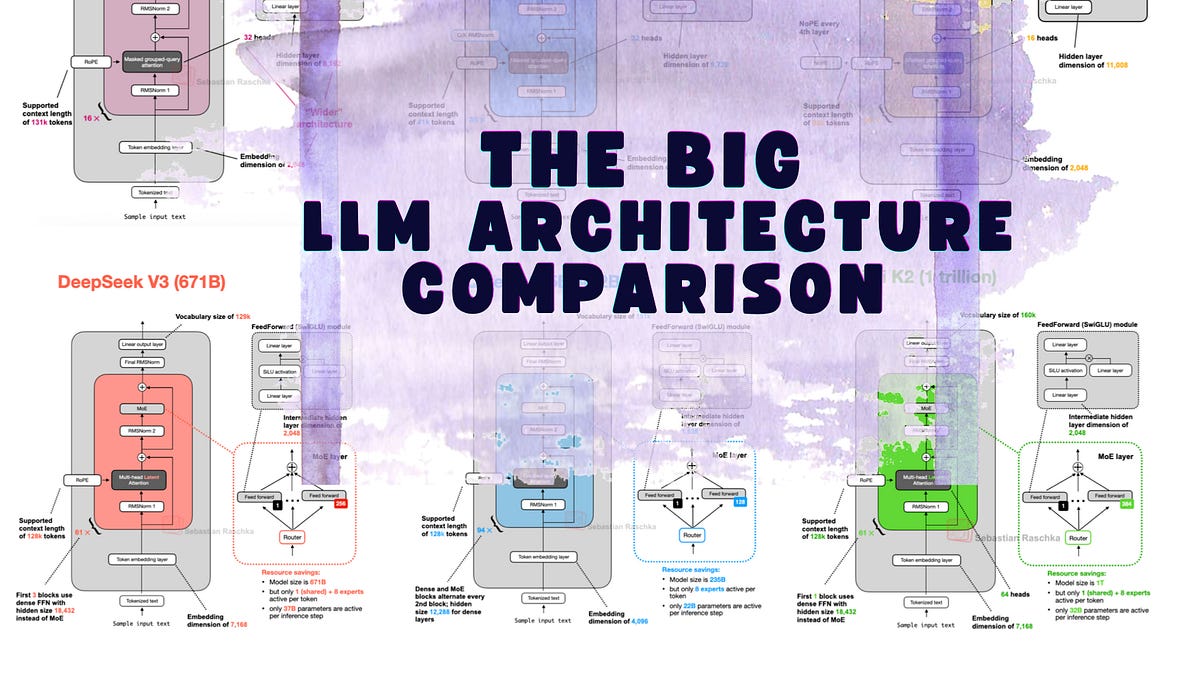

DeepSeek V3 pulveriza la hinchazón del caché KV con su atención latente

DeepSeek V3 acaba con la crisis de memoria en los LLM. Su Multi-Head Latent Attention reduce los cachés KV sin sacrificar rendimiento: aquí van los números.

⚡ Key Takeaways

- La MLA de DeepSeek V3 ahorra 40% en caché KV frente a GQA, revolucionando la economía de la inferencia. 𝕏

- La dispersión MoE es ya estándar, pero el entrenamiento del router sigue siendo el talón de Aquiles. 𝕏

- El núcleo transformer perdura; los retoques incrementales como la compresión conquistan mercados, no las revoluciones. 𝕏

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Ahead of AI