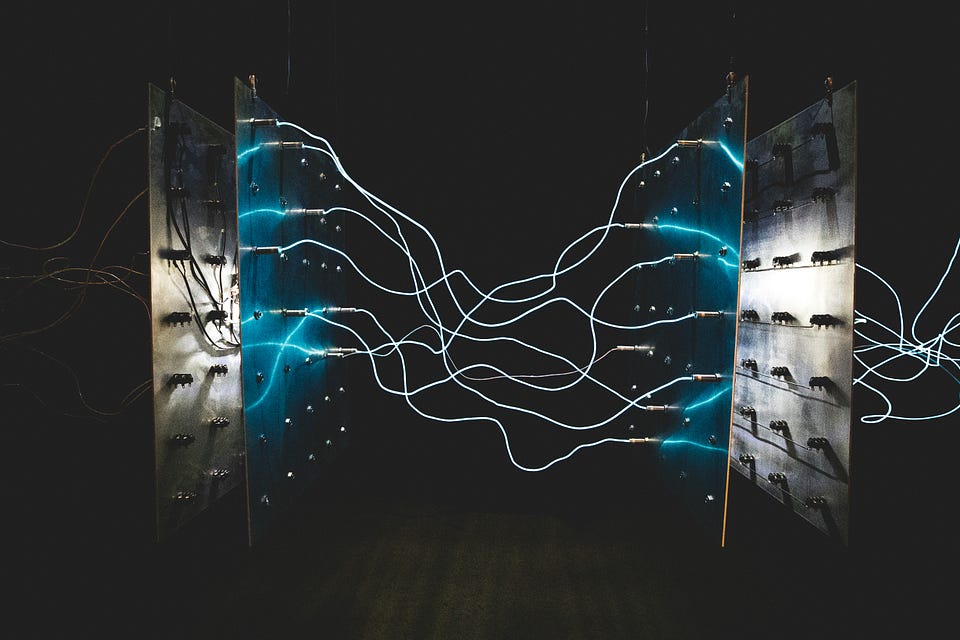

DenseNet y su telaraña de conexiones: Recableando el corazón del aprendizaje profundo

Imagina gradientes desvaneciéndose en la pesadilla de una CNN de 100 capas. DenseNet no salta capas: las conecta todas, reduce parámetros a la mitad y acelera el flujo de datos.

⚡ Key Takeaways

- Las conexiones de DenseNet de todas con todas generan L(L+1)/2 enlaces, acabando con la desaparición de gradientes.

- Concatenar en vez de sumar preserva características; ahorra hasta 4x parámetros frente a CNN tradicionales.

- Anticipa la atención de transformadores; listo para revivir en edge AI.

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards Data Science