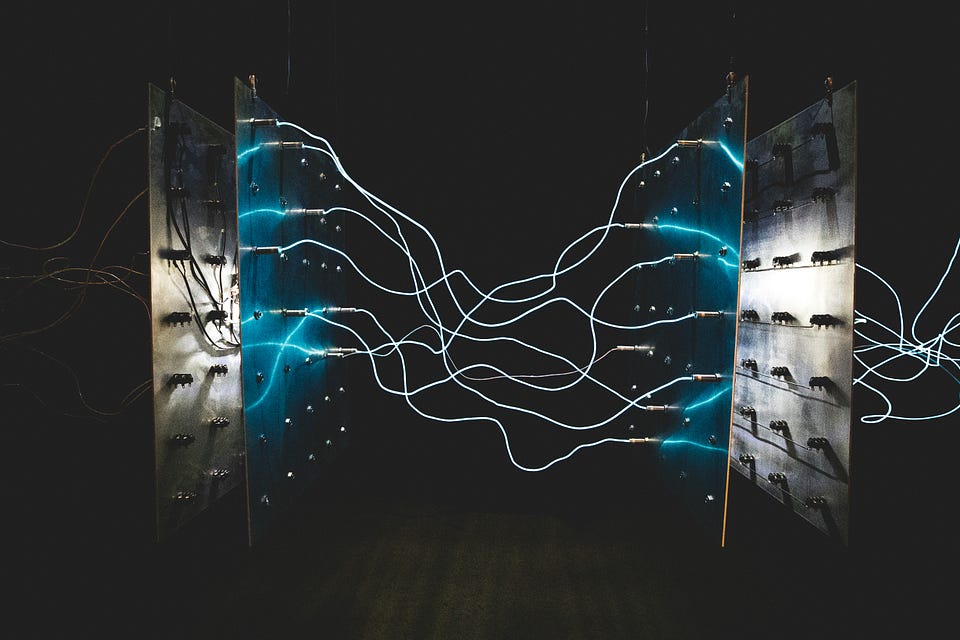

DenseNets wildes Verbindungsnetz: Deep Learning neu verdrahtet

Stellt euch vor: Gradienten verpuffen in einem 100-Lagen-CNN-Horror. DenseNet überspringt keine Schicht – verbindet jede verflixte, spart Parameter und jagt den Fluss hoch.

⚡ Key Takeaways

- DenseNets All-to-All-Verbindungen explodieren auf L(L+1)/2 Links – Vanishing Gradients pulverisiert.

- Konkatenation statt Summe erhält Features; Parameter-Einsparung bis 4x gegenüber klassischen CNNs.

- Vorbote von Transformer-Attention; perfekt für Edge-AI-Revival.

Worth sharing?

Get the best AI stories of the week in your inbox — no noise, no spam.

Originally reported by Towards Data Science